Contenido del curso

Conceptos basicos de MCP

- 5

Configuración de ambientes virtuales con UV en Python

05:48 min - 6

Creación de cliente Python para comunicación con servidor

07:19 min - 7

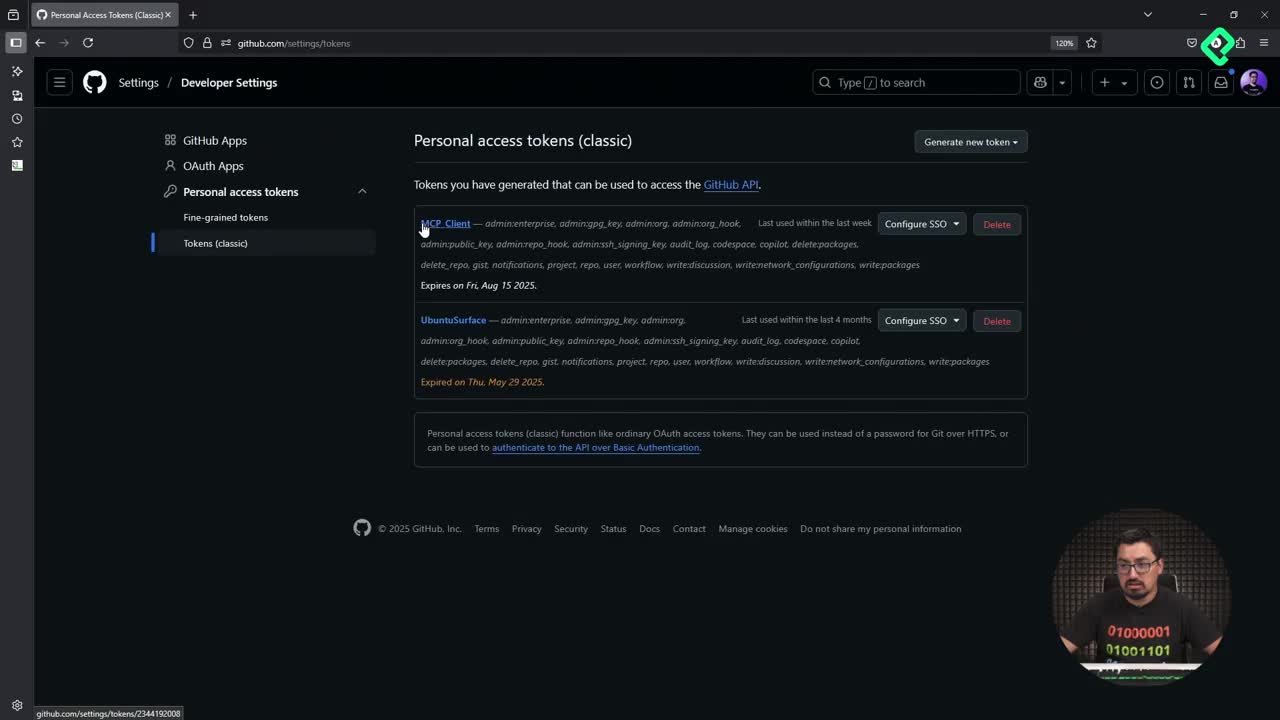

Integración de LLM con cliente MCP usando GitHub tokens

11:38 min - 8

Conexiones SSE en Fast MCP para streaming eficiente

05:45 min - 9

Integración de LLM con servidores MCP usando AI Toolkit

11:15 min - 10

Uso de servidor MCP por línea de comandos

08:54 min - 11

Despliegue de servidores MCP en Azure Container Apps

09:39 min - 12

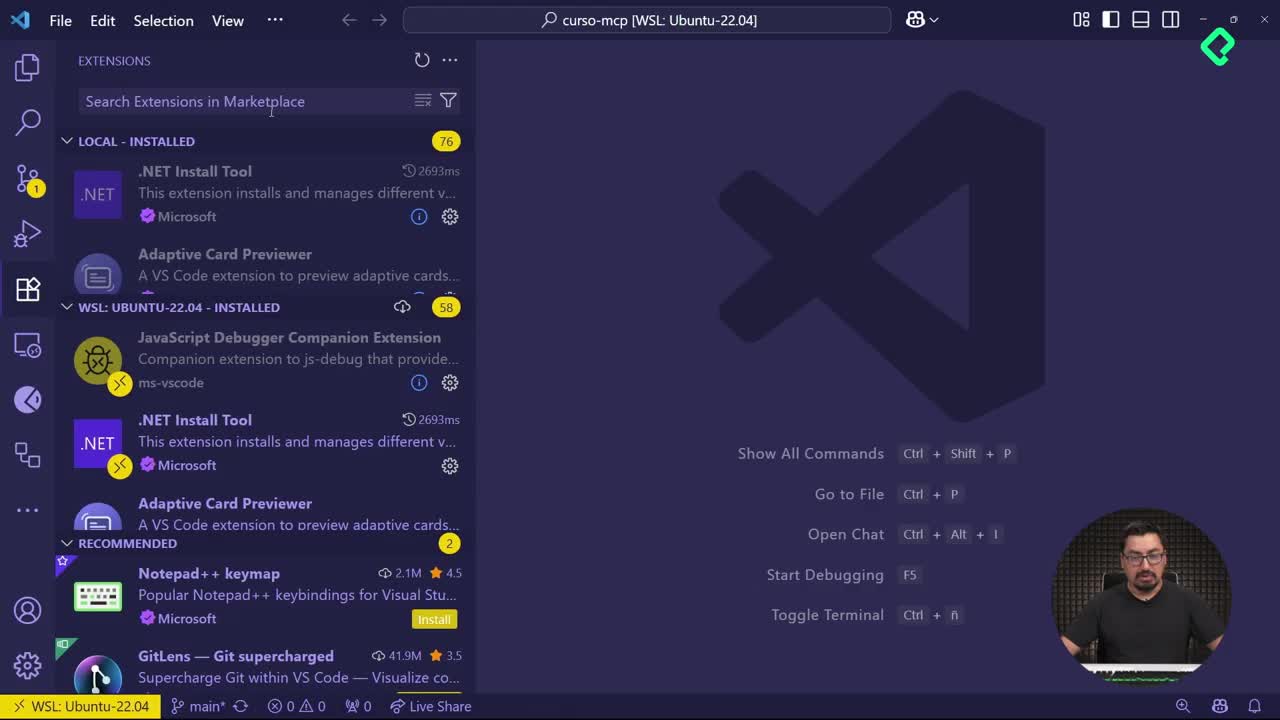

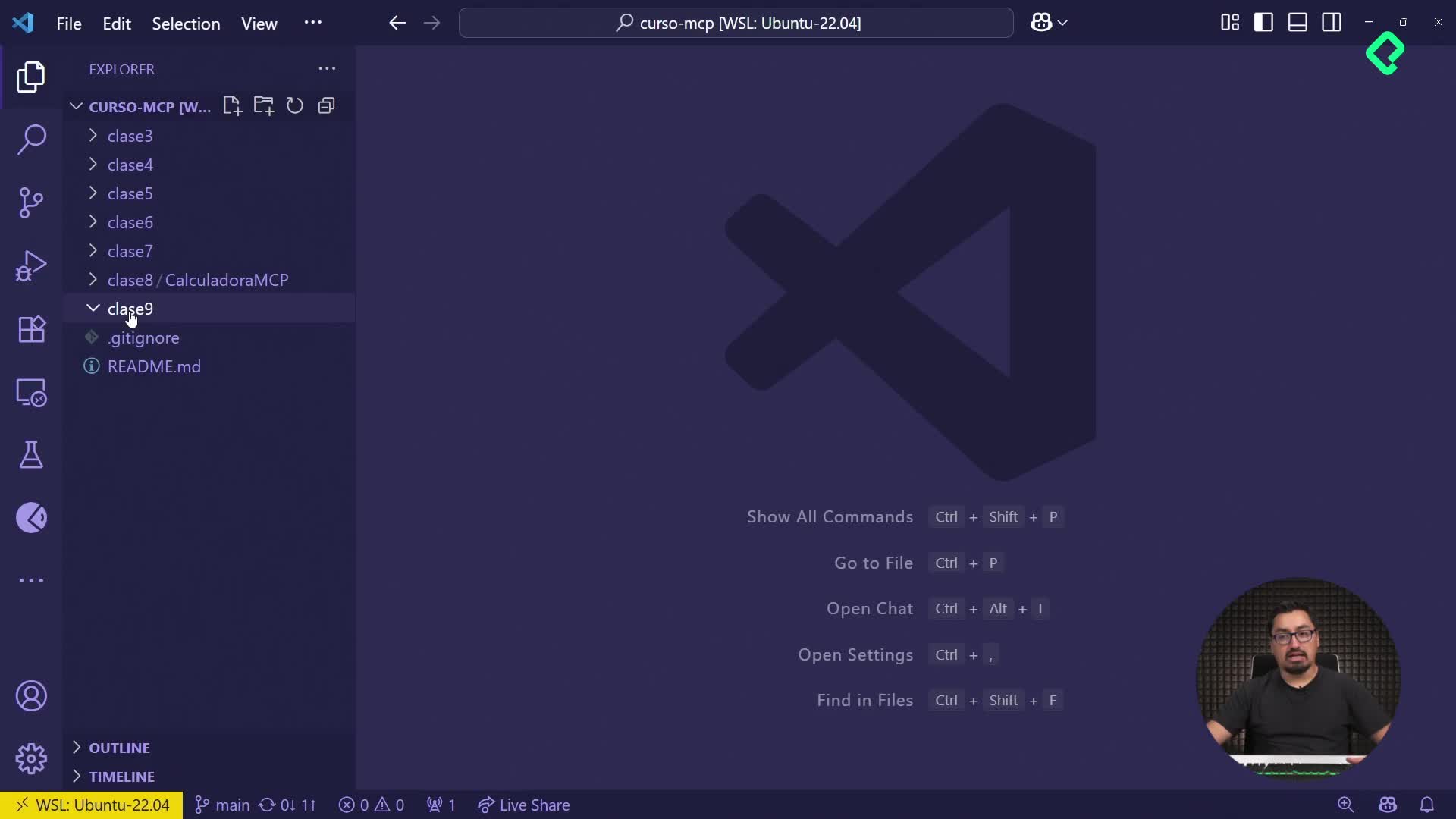

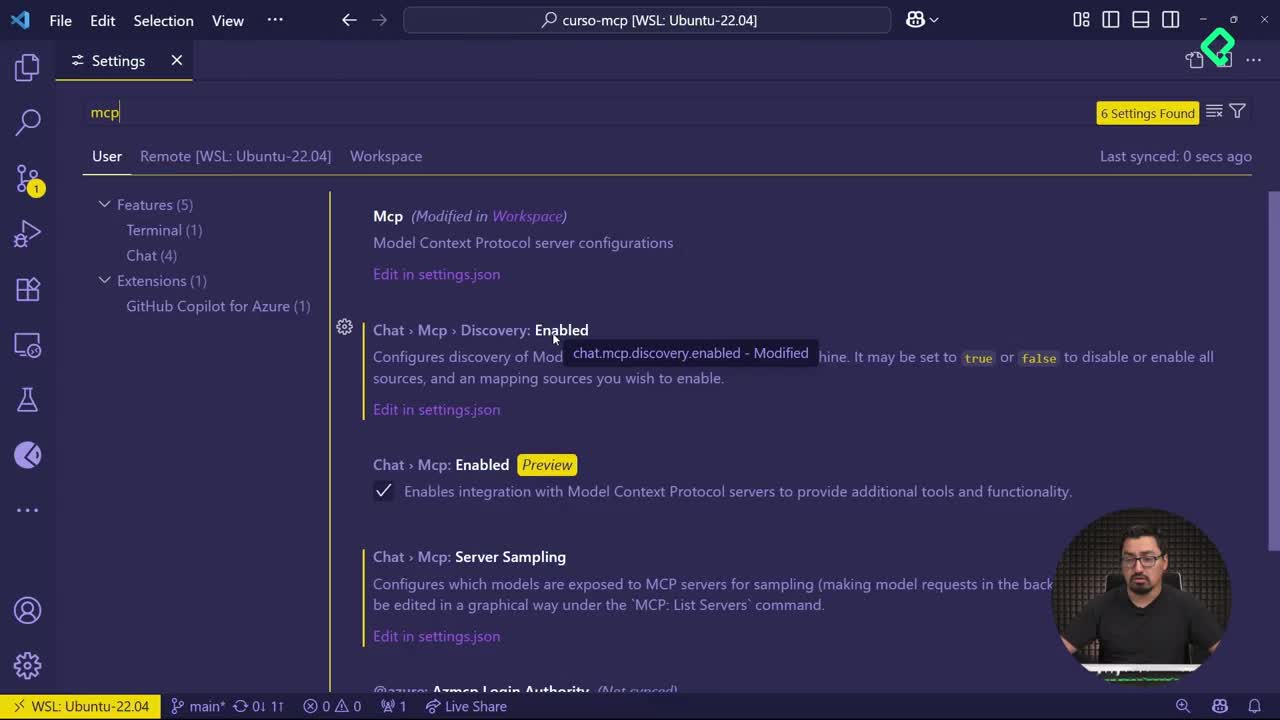

Configuración de servidores MCP en Visual Studio Code con Copilot

09:53 min

MCP avanzado

- 13

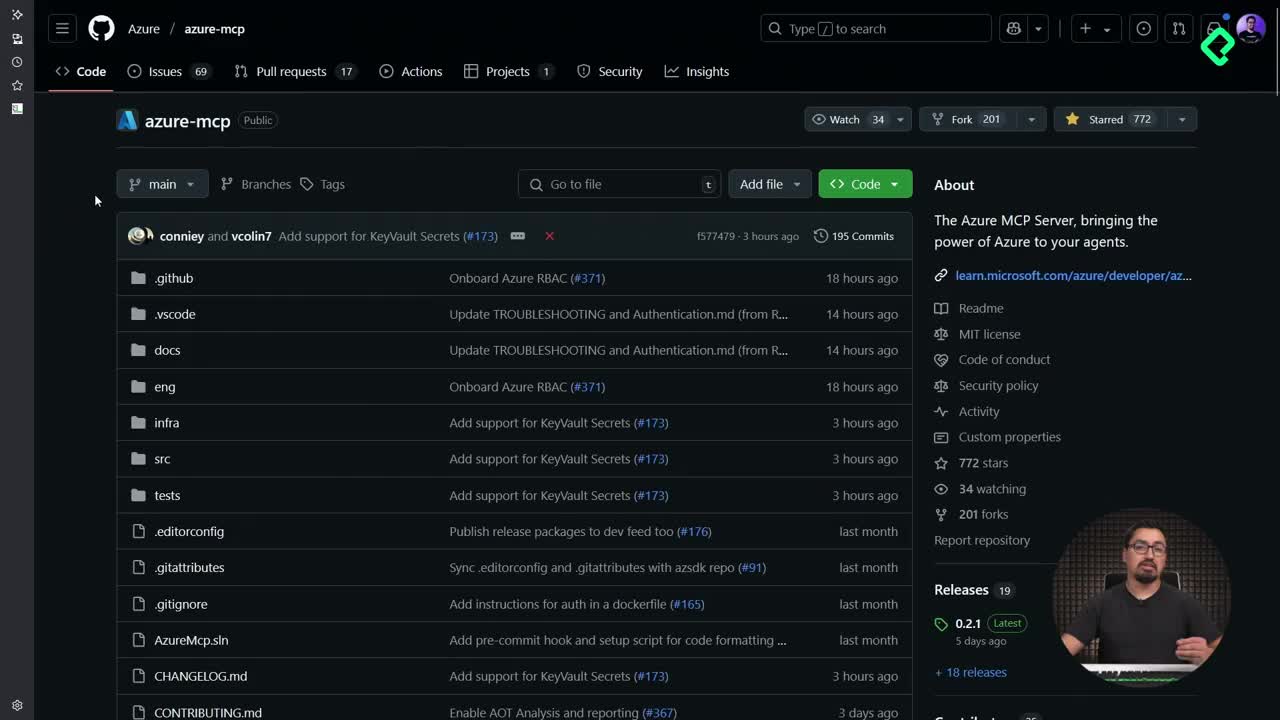

Configuración de Azure MCP Server en VS Code para consultas directas

06:46 min - 14

Herramientas avanzadas de MCP para optimizar servidores y seguridad

03:54 min - 15

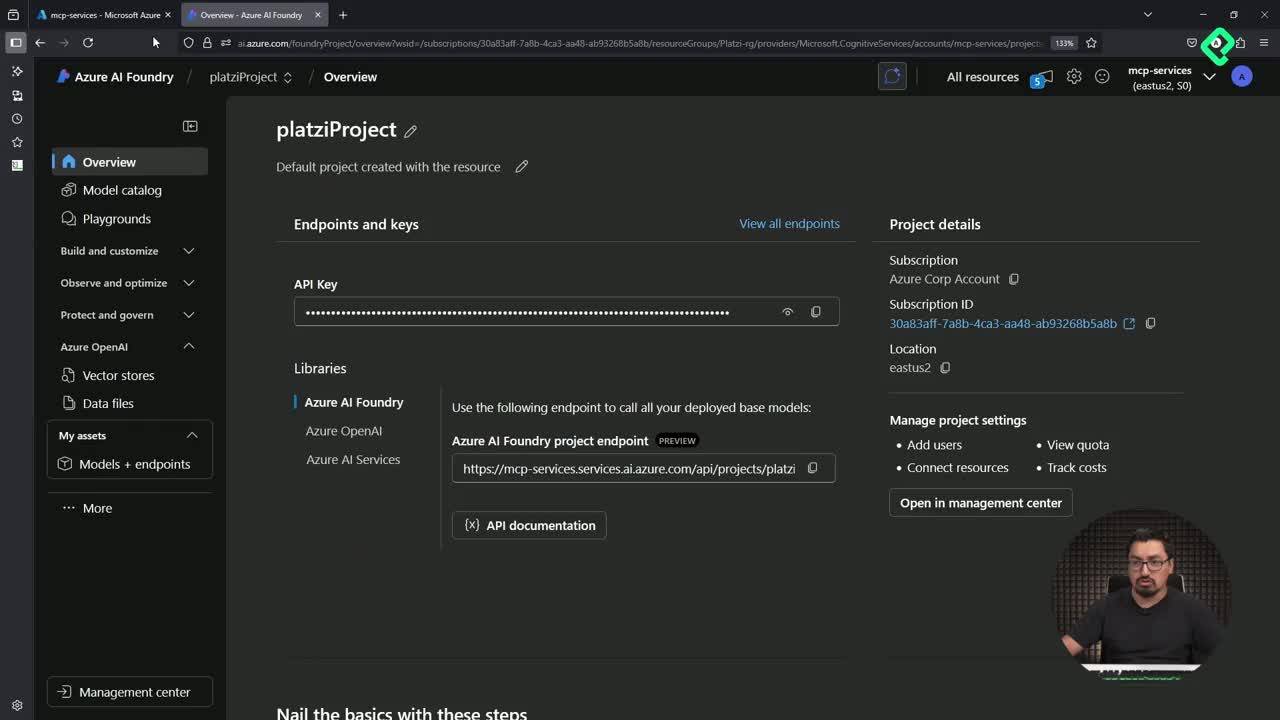

Configuración de LLM en Azure AI Foundry para MCP Server

14:10 min - 16

Procesamiento multimodal de imágenes en servidores MCP con NumPy

Viendo ahora - 17

Gestión de contexto dinámico en agentes de IA con MCP y Python

05:02 min - 18

Enrutamiento de herramientas con MCP Server

09:20 min

Integrando tu MCP con un agente

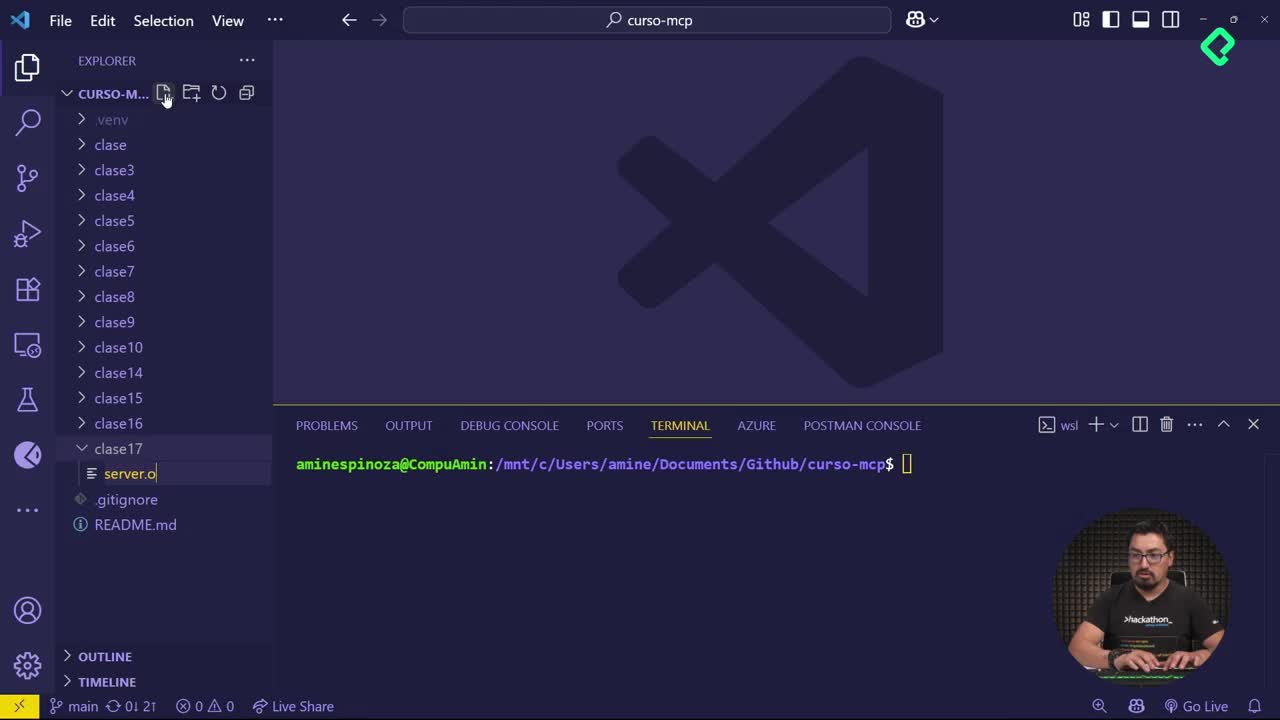

Procesamiento multimodal de imágenes en servidores MCP con NumPy

Resumen

La evolución de herramientas como ChatGPT hacia funcionalidades multimodales, capaces de procesar imágenes y audio aparte del texto, impulsa la importancia de entender e implementar modos multimodales en tus servidores usando MCP. Este tipo de servidor ahora puede analizar diferentes tipos de archivos gracias a bibliotecas especializadas como NumPy y Pillow, facilitando el procesamiento y análisis de datos complejos como imágenes.

¿Qué significa modo multimodal y por qué es importante?

Modo multimodal implica trabajar con diferentes tipos de datos como texto, imágenes y audio. Hasta hace poco, herramientas como ChatGPT se limitaban al texto, pero la demanda mostró la necesidad de interacción con otros tipos de contenidos. Utilizar modo multimodal permite:

- Interacciones más ricas y diversas.

- Procesamiento avanzado de datos visuales y auditivos.

- Desarrollar aplicaciones más completas y útiles.

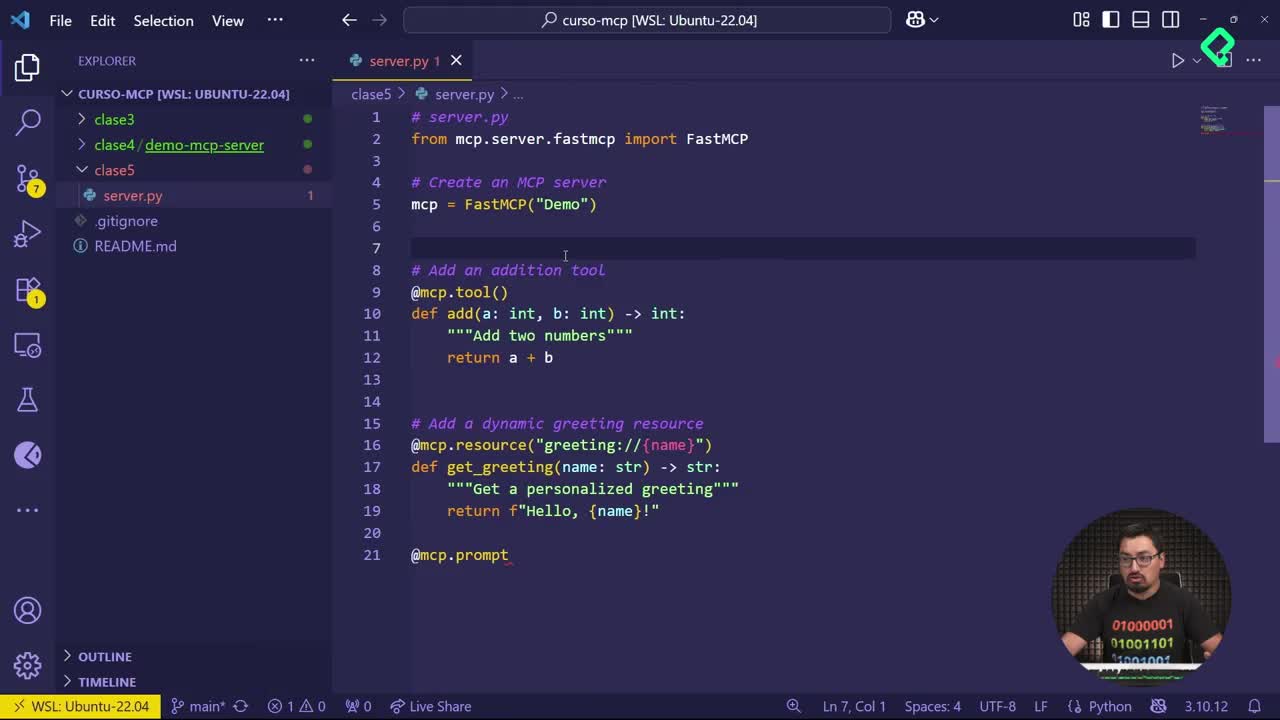

¿Cómo implementar NumPy y Pillow en MCP?

Puedes extender las funcionalidades de tus servidores MCP a imágenes, gracias a bibliotecas como NumPy y Pillow:

- Instala ambas bibliotecas:

pip install numpy pillow

- Luego integra las referencias necesarias en tu código de servidor:

import numpy as np from PIL import Image

- Usa FastAPI para estructurar tu servidor, creando endpoints adecuados para manejar distintos tipos de archivos, por ejemplo:

from fastapi import FastAPI, UploadFile app = FastAPI() @app.post("/MCPImageBrightness") async def analizar_brillo(archivo: UploadFile): imagen = Image.open(archivo.file) arreglo = np.array(imagen) brillo = arreglo.mean() return {"brillo": brillo, "mensaje": "la imagen ha sido procesada exitosamente"}

¿Cómo ejecutar y probar tu servidor?

Para ejecutar tu servidor, utiliza Uvicorn desde la terminal:

uvicorn server:app --host localhost --port 8000

Confirma tu servidor enviando una imagen mediante una petición CURL de esta forma:

curl -X POST "http://localhost:8000/MCPImageBrightness" -F "archivo=@ruta/a/tu/imagen.jpg"

Recibirás una respuesta indicando el nivel de brillo y confirmando el éxito del proceso.

¿Cómo convertirlo en una herramienta integrada?

Un reto adicional que apuntala tu aprendizaje es transformar tu endpoint POST en una herramienta directamente integrada en el servidor MCP. Es recomendable intentar este proceso por ti mismo antes de consultar las soluciones disponibles. Esto reforzará tus conocimientos prácticos en la integración de funcionalidades multimodales.