La creación y gestión eficiente de índices es esencial para aprovechar al máximo los sistemas inteligentes basados en Azure AI Search. Durante este módulo exploraremos cómo utilizar Jupyter Notebooks para automatizar y gestionar múltiples índices, ampliando considerablemente nuestra base de datos vectorial. Al implementar distintos modos de compresión y organizar diferentes estructuras, este proceso permitirá entender claramente la importancia crucial del indexing en sistemas de Inteligencia Artificial operados desde la nube.

¿Por qué es importante crear múltiples índices en Azure AI Search?

Crear varios índices en Azure AI Search es indispensable para manipular adecuadamente grandes volúmenes de información. Al comparar múltiples índices con diferentes configuraciones, podremos evaluar claramente el rendimiento, el consumo de recursos y cuál es el mejor escenario según nuestro propósito específico.

¿Qué son los algoritmos de indexación y por qué utilizarlos?

Los algoritmos de indexación nos permiten fragmentar y procesar información para alojarla eficientemente en bases de datos vectoriales. Entre los principales encontramos:

- Baseline: el método más sencillo.

- Baseline S: variante que considera embedding almacenado.

- Scalar Full: implementación avanzada en términos de compresión.

Elegir un algoritmo adecuado impacta directamente en la manera como se distribuye y almacena nuestra información.

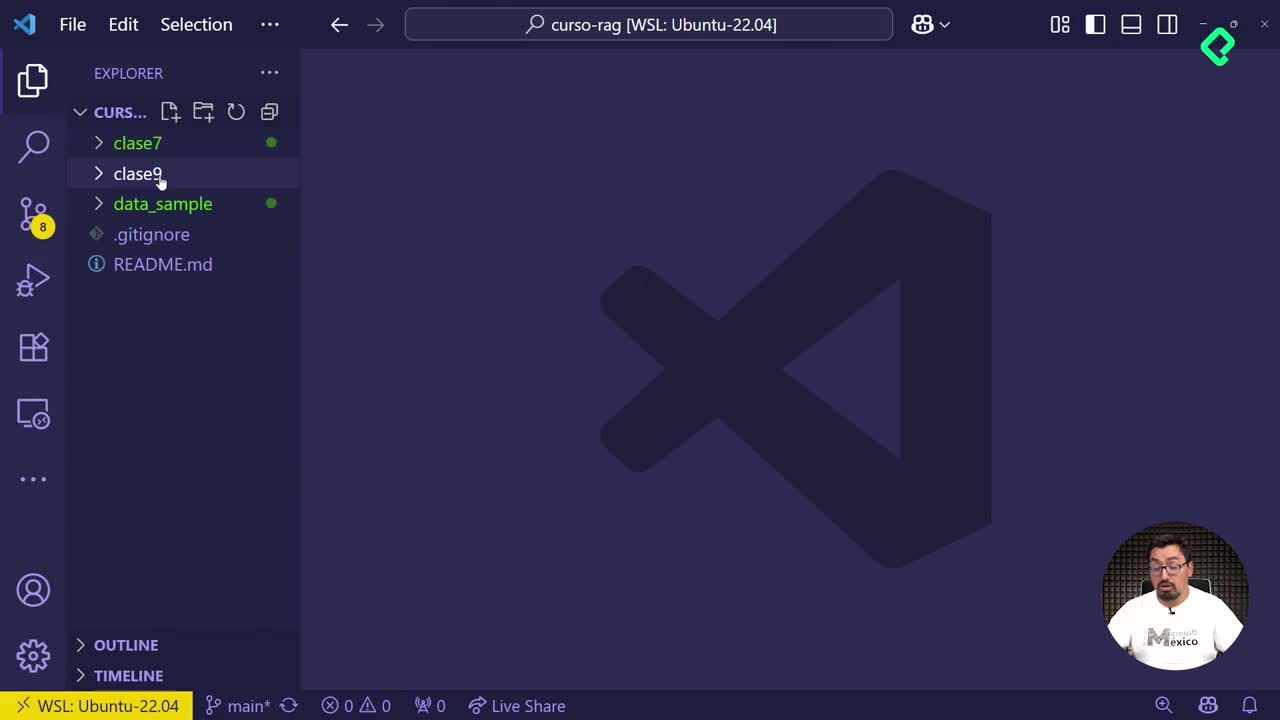

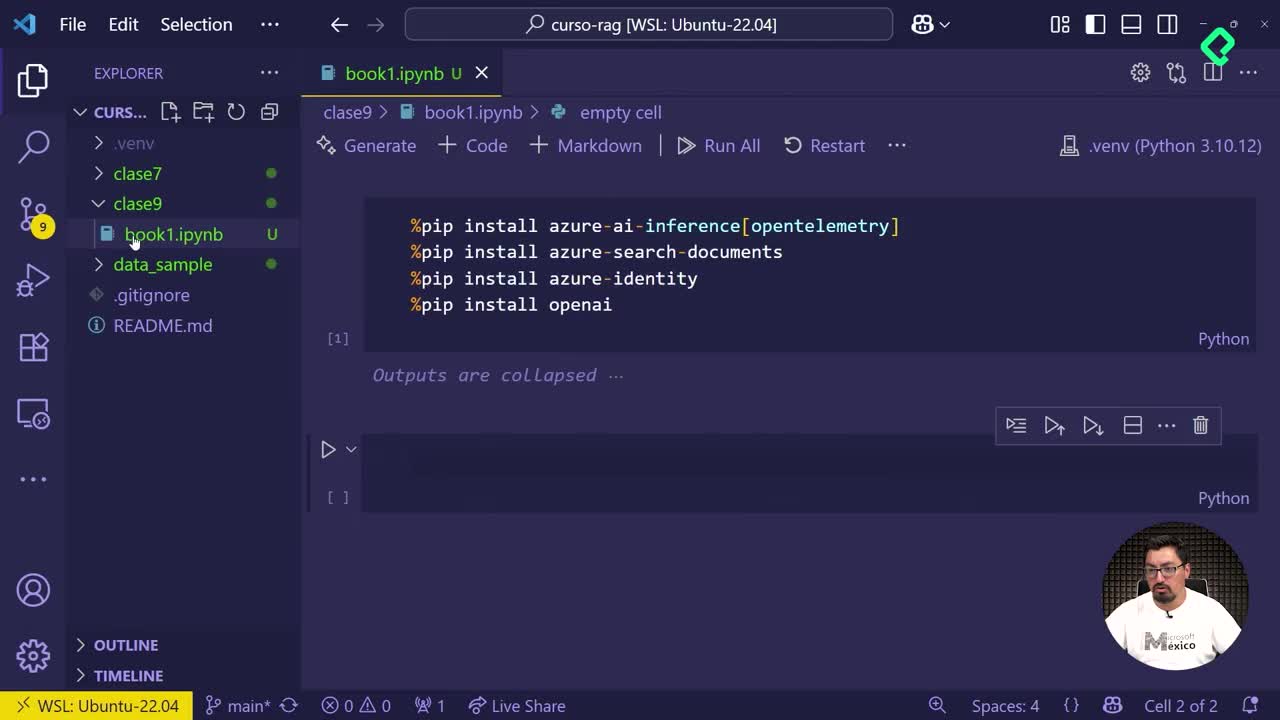

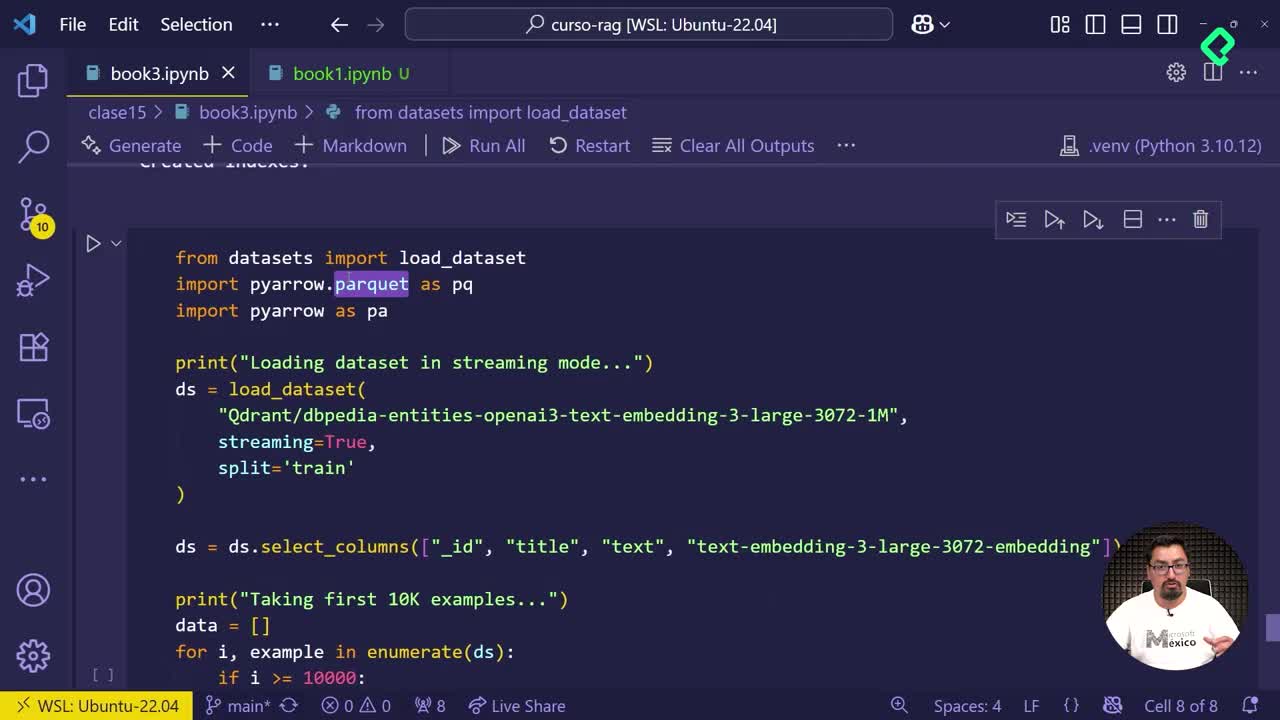

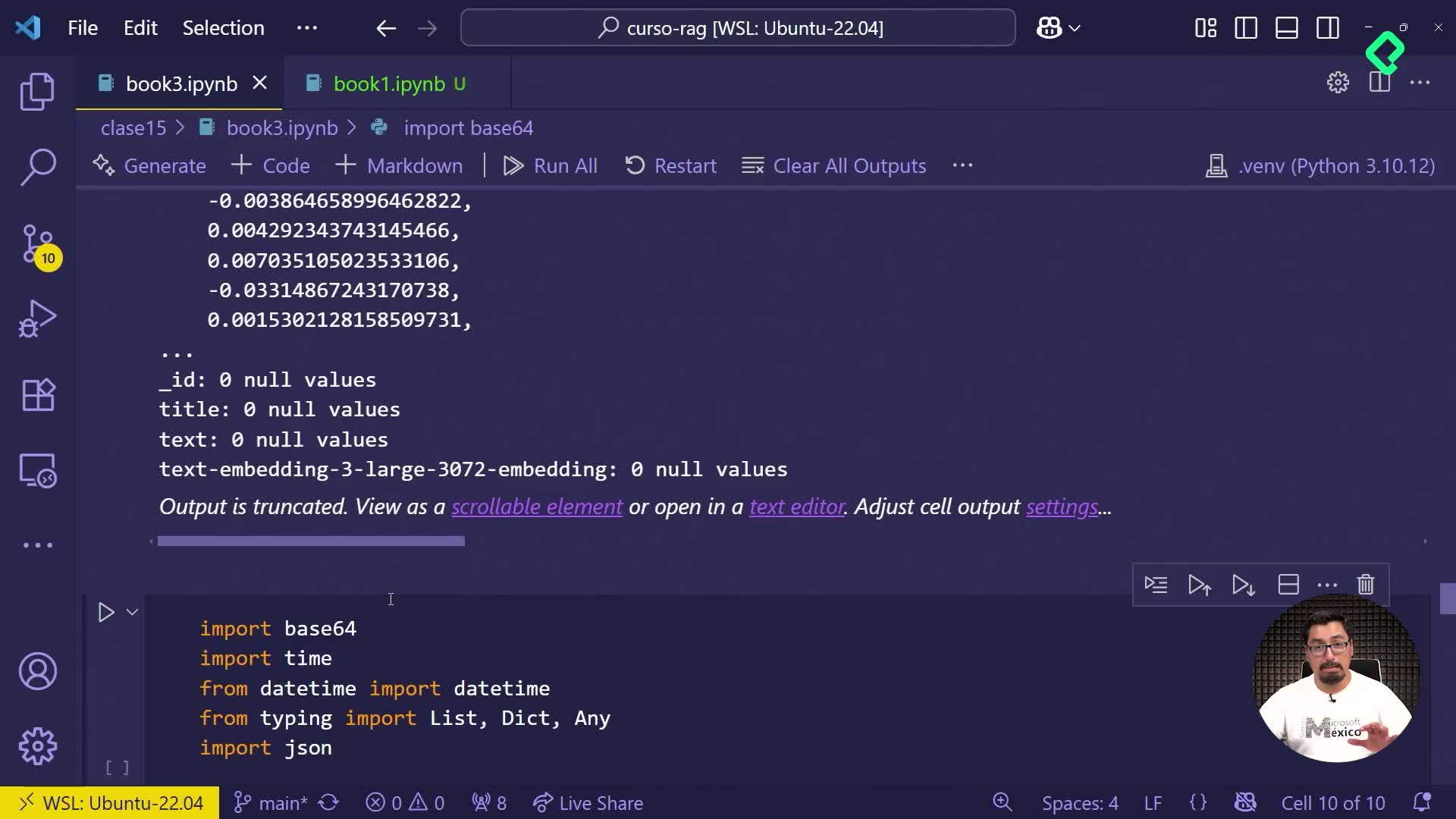

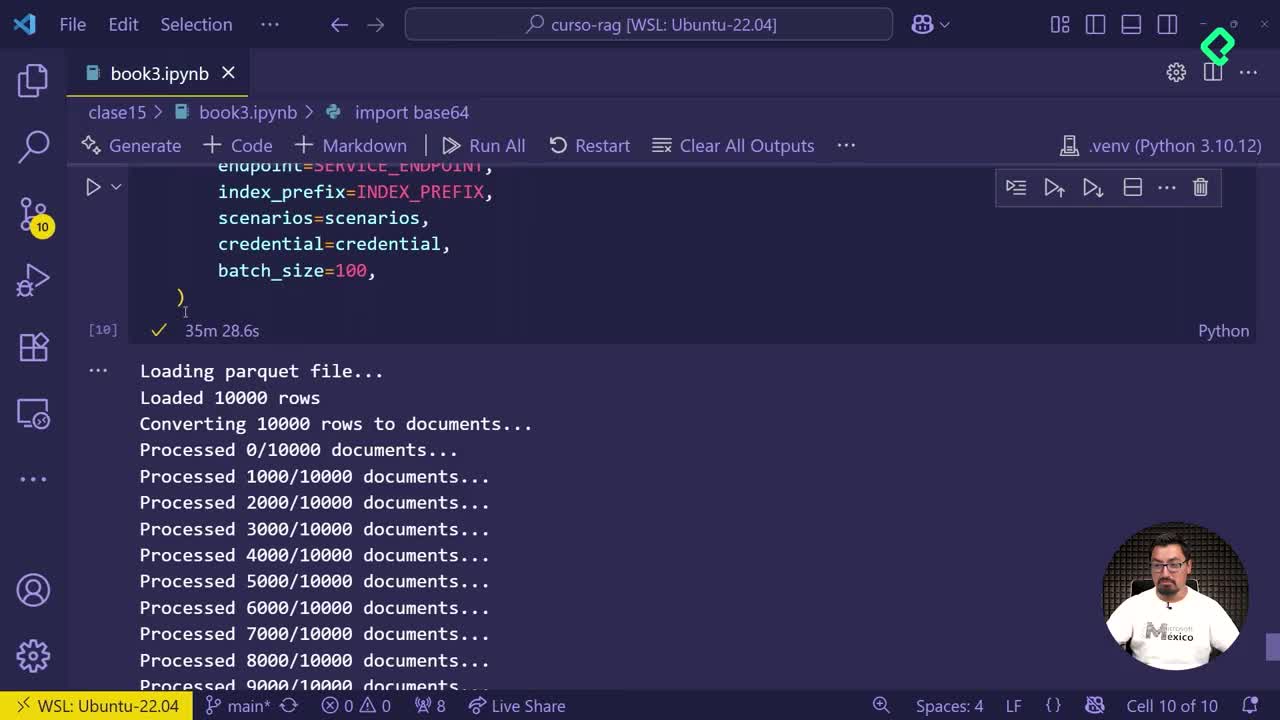

¿Cómo organizamos el proceso desde Jupyter Notebook?

Desde Jupyter Notebook, el proceso se realiza mediante pasos concretos y fáciles de seguir:

- Instalación y declaración de importaciones necesarias para desplegar la información.

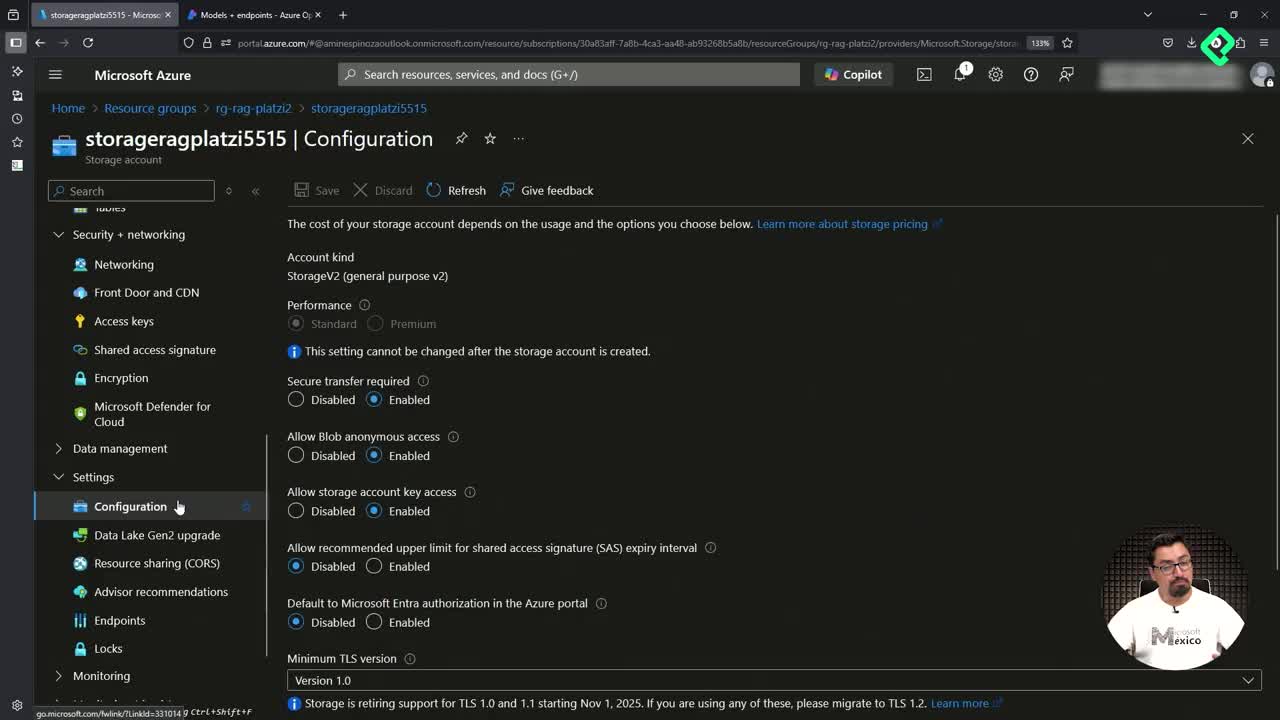

- Configuración de variables globales, como los endpoints y claves obtenidas previamente desde Azure y OpenAI.

- Carga y definición del archivo JSON para configurar los índices y establecer parámetros específicos de compresión y fragmentación.

- Ejecución del código encargado de crear, desplegar y vincular los índices al servicio Azure Search.

Este flujo operativo permite al usuario tener un control claro y organizado sobre cada aspecto del proceso.

¿Qué ventajas ofrece gestionar índices con diferentes métodos de compresión?

Cada método de compresión afecta la velocidad del proceso, el consumo de almacenamiento y cómo organizamos la información en nuestra base de datos. Al experimentar con varios métodos desde una única plataforma, puedes evaluar:

- Optimización en velocidad de búsqueda.

- Consumo de recursos (memoria y CPU).

- Formatos ideales para diferentes volúmenes y tipos de datos.

Te invitamos a experimentar con diferentes configuraciones y observar cómo estas influyen en el rendimiento general de tus sistemas basados en Inteligencia Artificial.