Estos son algunos de los anuncios hechos en el **Google I/O**2018, evento para desarrolladores que presenta los lanzamientos de la compañía.

Durante la presentación esta tarde, se dieron a conocer varias novedades en los productos de Google, que le está apuntando a un desarrollo más avanzado de las IA.

Sundar Pichai, CEO de Google, dio inicio a la conferencia y fue el primero en mostrarnos lo que viene para la plataforma.

“Es claro que la tecnología puede ser una fuerza positiva. Pero es igualmente claro que no podemos dejar de mirar con los ojos muy abiertos a los cambios que la tecnología crea”, mencionó Pichai cuando comenzó a mencionar sus esfuerzos y las pruebas que han estado haciendo para diagnosticar la retinopatía diabética en países subdesarrollados.

“Actualmente podemos predecir cualitativamente la oportunidad de readmisión con 48 horas de anticipación”. Se espera que Google publique un documento sobre estos avances.

Clave Morse en dispositivos móviles - Google I/O 2018

Aplicando machine learning a clave Morse, los dispositivos móviles cobrarán una mayor relevancia para la población en condición de discapacidad.

El teclado de Google ahora tiene soporte a clave Morse, con texto predictivo y sugerencias.

Smart Compose - Google I/O 2018

Gmail tendrá un gran upgrade: texto predictivo. Pero no como lo conocemos, sino que utilizando machine learning, sugerirá frases a medida que escribimos. Presionando únicamente Tab, se escogerá el texto sugerido.

“Se encargará de cosas mundanas como las direcciones. Desde que lo probamos, he mandando muchos más mails a toda la compañía”, agregó Pichai.

Mejores subtítulos - Google I/O 2018

Uno de los problemas más típicos en el ‘Closed Caption’ es cuando las personas dialogan y la traducción se bloquea. Para esto, Google está trabajando con AI y machine learning. La inteligencia artificial ayudará a lograr discernir quiénes están hablando en determinado momento, incluso cuando estén gritando, y de esta manera generar los subtítulos de manera más fluída

Google Photos - Google I/O 2018

Comenzando con el dato de que cada día hay más de 5 billones de fotos vistas en Google Photos, nos presentan una serie de updates para la forma en que visualizamos y trabajamos la fotografía en sus dispositivos.

Smart Actions es una característica de AI que permitirá al dispositivo entender quiénes están en una foto y ofrecer la sugerencia de compartirla inmediatamente con esos contactos.

Si una foto está subexpuesta, la aplicación ofrecerá la sugerencia de arreglar su brillo o mejorar su color. Y, si reconoce la foto de un documento, permitirá la opción de convertirlo a PDF de manera inmediata.

Además, dependiendo el tipo de fotografía, podremos aislar el color de una persona/objeto y dejar el resto en escala de grises. O, en caso de fotografías antiguas, darle color a todo lo que esté en grises o blanco/negro.

Google Assistant - Google I/O 2018

Uno de las características más interesantes es el nuevo Google Assistant, que ahora será controlado casi completamente por la voz.

Utilizando WaveNet de DeepMind, permitirá crear una voz de AI mucho más natural.

Con 6 nuevas voces, cada una con diferentes acentos, da una sensación ‘más humana’ con el asistente.

Para esto, utilizaron al músico John Legend, que será una de las voces a escoger del asistente.

“Se pone fastidioso estar repitiendo “Hey Google” cada vez que necesitas usarlo, esta es una de las cosas que cambiamos en el asistente” dijo Scott Huffman, VP de Ingeniería de Google.

Conversación Contínua - Google I/O 2018

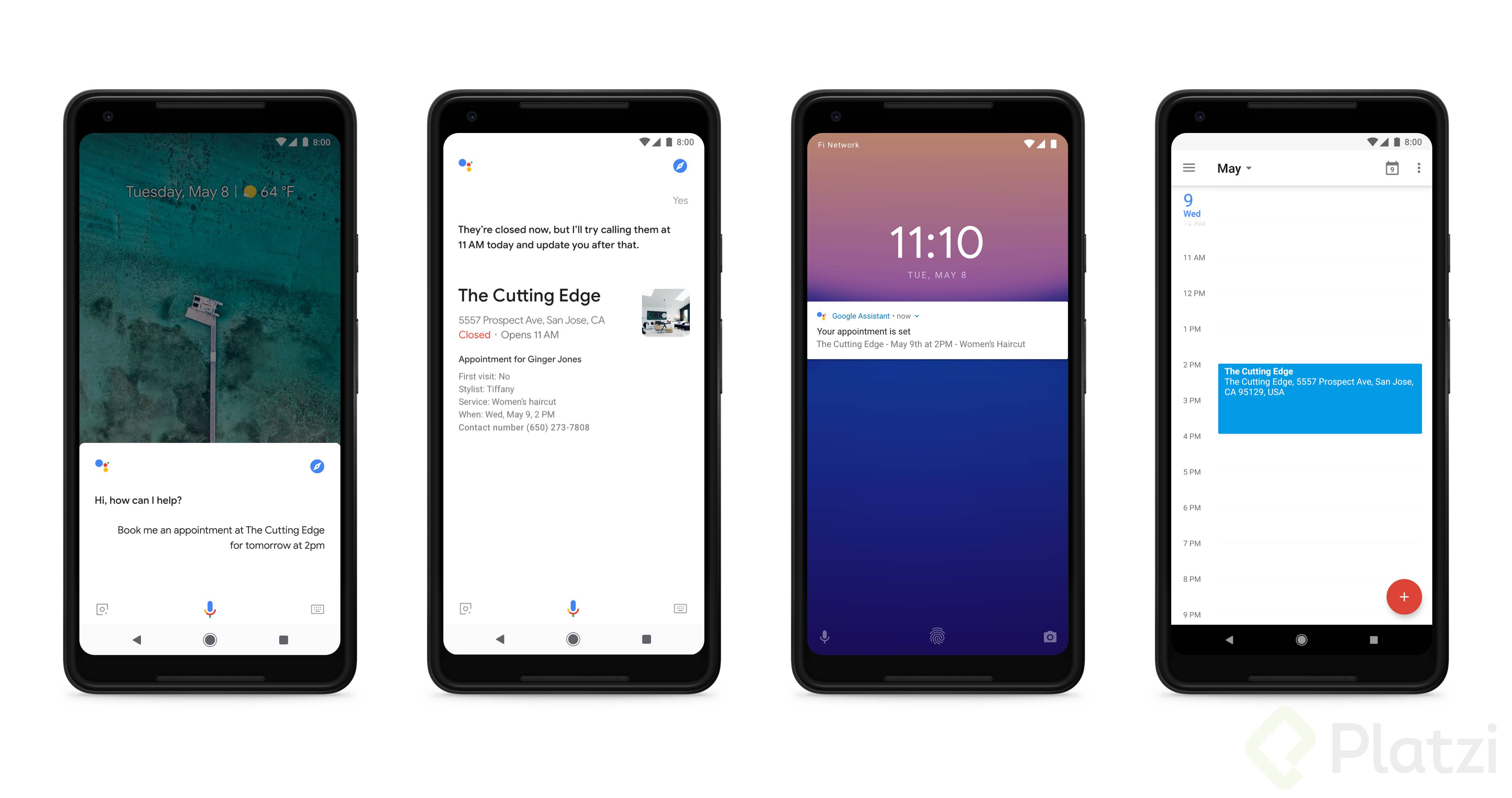

Un anunció que se dió en el blog de Google, que fue demostrado en vivo, fue su upgrade de AI para las conversaciones: “Anunciamos Google Duplex, una nueva tecnología para llevar conversaciones de manera natural para esas tareas del ‘mundo real’ que tenemos en el teléfono. Esta tecnología está enfocada directamente a completar tareas específicas, como agendar citas.

Para estas tareas, el sistema puede llevar una experiencia conversacional de la manera más natural, permitiendo a otras personas hablar normalmente con la máquina, como si fuera otra persona más”.

Esto quedó demostrado en el video en que muestran una conversación máquina-humano para pedir una cita al salón de belleza.

Por Favor, Google - Google I/O 2018

Suena divertido. Esta característica está enfocada en las familias, en la que dará juegos familiares y otras actividades que buscan reforzar el ser gentil y pedir las cosas de buena manera a los niños, pues encontraron que con el avance de la AI, se corre el riesgo de que se pierdan esos modales en los más pequeños.

Google News - Google I/O 2018

Una nueva forma de tener las noticias más relevantes en el feed. Con el app de Google News, las noticias locales aparecerán destacadas y evolucionará de acuerdo a los hábitos e intereses del lector.

Los videos en YouTube también estarán de manera destacada, con una nueva característica llamada “Newscasts” que será como las historias de Instagram pero exclusivamente para noticias.

Esta actualización de Google News permitirá que la gente vea variedades de formatos y fuentes de sus noticias locales. “Full Coverage” es la característica nueva que ayudará a proveer historias relacionadas, contexto e incluso eventos relacionados con las noticias.

Android P - Google I/O 2018

Aunque ya habían lanzado una parte para desarrolladores, nos contaron de las 3 grandes características del nuevo Android P:

Inteligencia - Android P

La sociedad con DeepMind les permitió crear una característica llamada “Batería Adaptativa”. Utilizando Machine Learning permitirá conocer cuáles aplicaciones utilizamos frecuentemente. De esta manera, restringirá de manera automática los procesos para que la batería dure mucho más.

El ‘Brillo Adaptativo” aprenderá del usuario de acuerdo al ambiente, para mejorar la opción de autobrillo.

“App Actions” es una característica que predecirá las acciones de los usuarios de acuerdo a sus patrones de comportamiento. DE esta manera podremos usar las apps de manera más rápida. Por ejemplo, cuando buscamos un restaurante en el celular, nos abrirá el app de pedir domicilios para facilitarnos la tarea.

Simpleza Android P

La forma de navegar en el dispositivo fue revisada y mejorada, buscando la simpleza de movimientos y la eficiencia en el uso de los gestos con las manos.

Por ejemplo, podremos escoger cuáles apps tendrán rotación automática y cuáles no.

Bienestar Digital Android P

Buscando el bienestar de los usuarios, Android P trae grandes cambios enfocados en ello.

Habrá un nuevo tablero que mostrará las horas del día que gastamos en el celular, junto a las aplicaciones que hemos usado y por cuánto tiempo. Esto permitirá que pongamos límite a las aplicaciones para usarlas el tiempo que creamos correcto.

Un mejor modo de No Molestar permitirá parar las notificaciones visuales y de audio, así como las vibraciones.

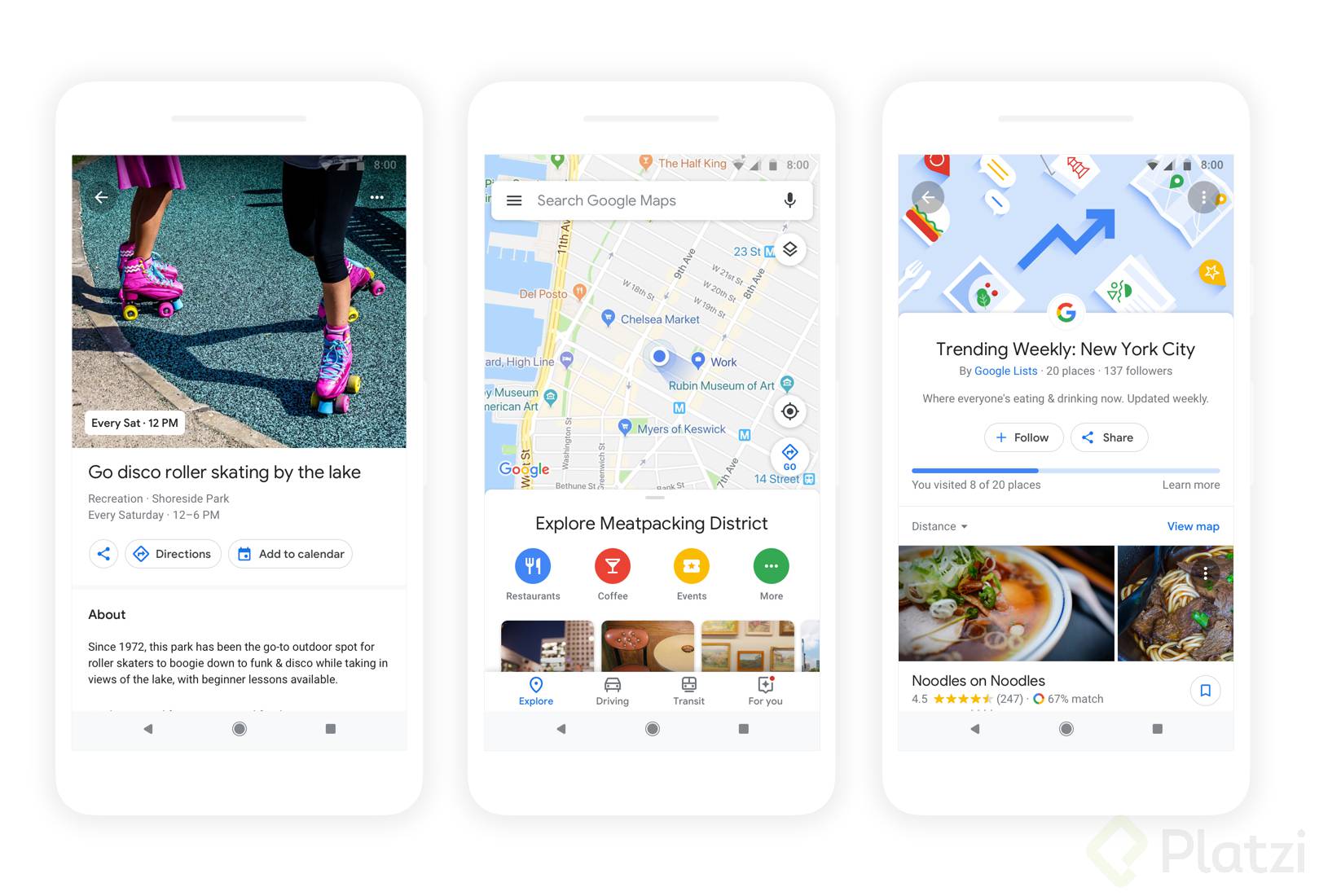

Google Maps - Google I/O 2018

La aplicación tendrá una nueva pestaña llamada “For You”, que mostrará los negocios nuevos del área así como restaurantes que están siendo tendencia.

Añadieron un puntaje llamado "Your Match” que, basado en tu historial, te dirá que tanto puede o no gustarte un nuevo restaurante.

Además de esto, una de las nuevas características que se incorporarán es Computer Vision, que combina la cámara con Google Street View para dar una experiencia AR en la aplicación.

También tendrá un rediseño en su pestaña ‘Explorar’, que anunciará novedades sobre eventos, restaurante y opciones de actividades de acuerdo a los gustos del usuario.

¿Qué fue lo mejor y lo peor de estos anuncios? Cuéntanos en los comentarios.

Curso de Fundamentos Prácticos de Machine Learning

COMPARTE ESTE ARTÍCULO Y MUESTRA LO QUE APRENDISTE