Anteriormente, hablamos de tecnologías text to image como Dalle 2 y la disrupción que representa en la inteligencia artificial, lo interesante es que Dalle 2 abrió la caja de pandora.

Ahora, existen modelos muy similares como Imagen y Parti de Google, Midjourney, Simulacrabot, Shonenkov AI, Deep AI Text to Image, CrAIyon y muchos otros modelos increíbles para generación de imágenes con base a prompts, pero es Stable Diffusion de stability.ai quien atrae todas las miradas.

🎨Aprende más sobre creación de contenido audiovisual: con IA, realidad aumentada, para redes, y mucho más en la escuela de contenido audiovisual de Platzi.

¿Qué es Stable Diffusion?

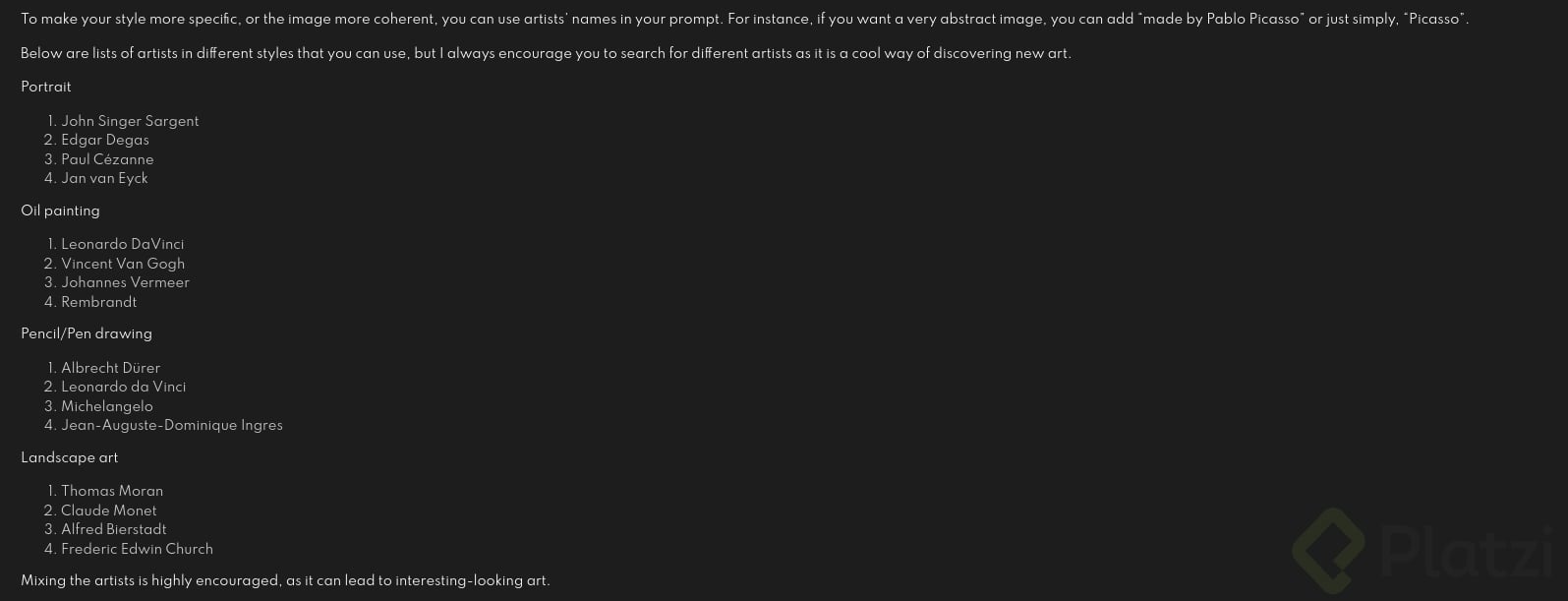

Stable diffusion es un modelo mas de inteligencia artificial tipo text to image. Lo interesante de este modelo es, por supuesto, la calidad de las imágenes que no tiene nada que envidiarle a Dalle 2 y, además, cuatro aspectos importantes:

- Generar imágenes de personas reales

- Crear imágenes sin restricciones de censura:

- Manejar múltiples estilos artísticos

- ¡Es gratis y de código abierto a toda la comunidad! 🤯

Aprende inteligencia artificial desde cero: conoce todos los cursos

¿Cómo puedo usar Stable Diffusion?

Actualmente tenemos dos formas de hacerlo:

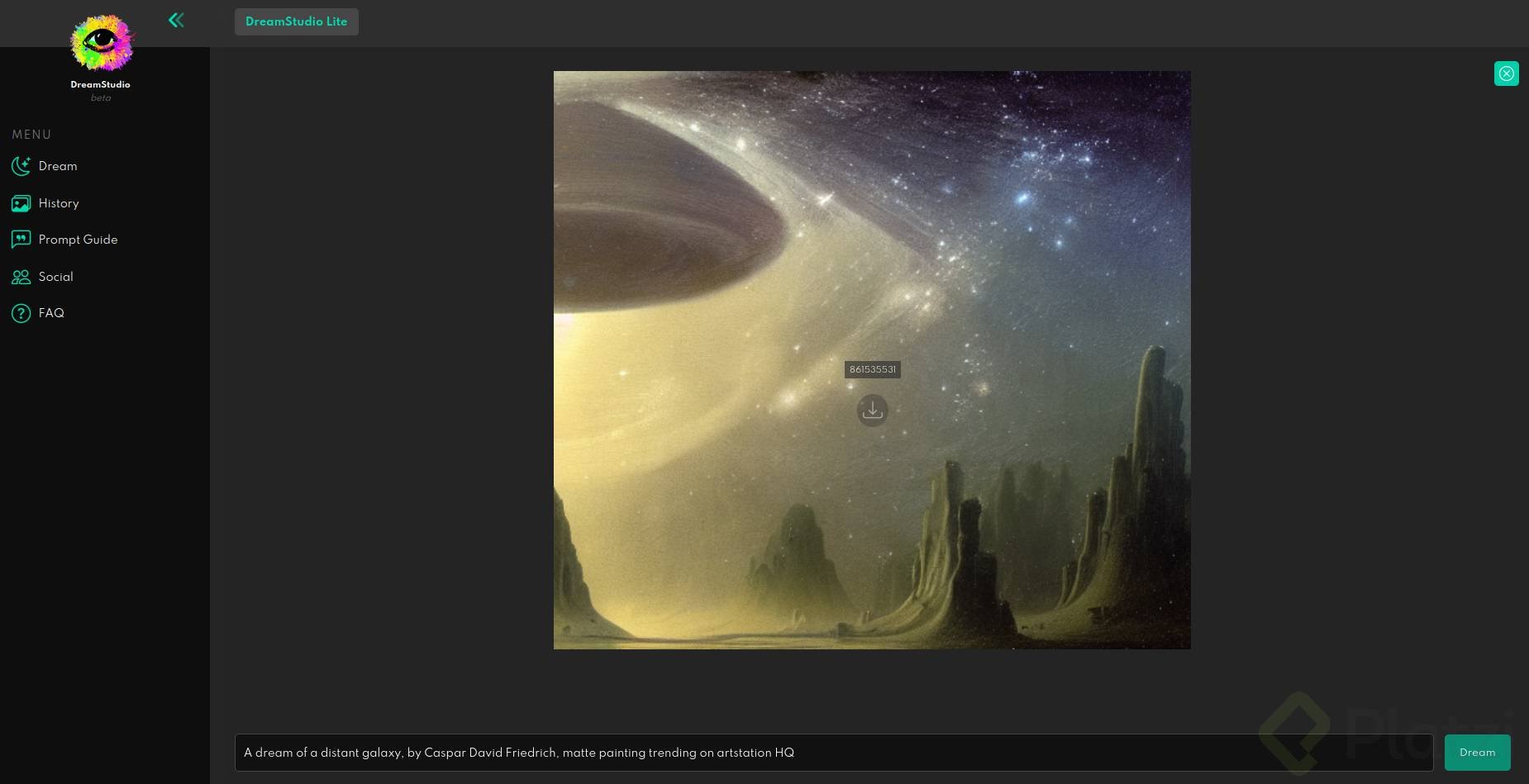

1. A través de Dreamstudio

Puedes registrarte en http://beta.dreamstudio.ai, una página beta que está disponible para todo público. Beta nos ofrece una interfaz amigable para generar nuestras imágenes, pero con un límite de ejecuciones.

2. Usando HuggingFace 🤗

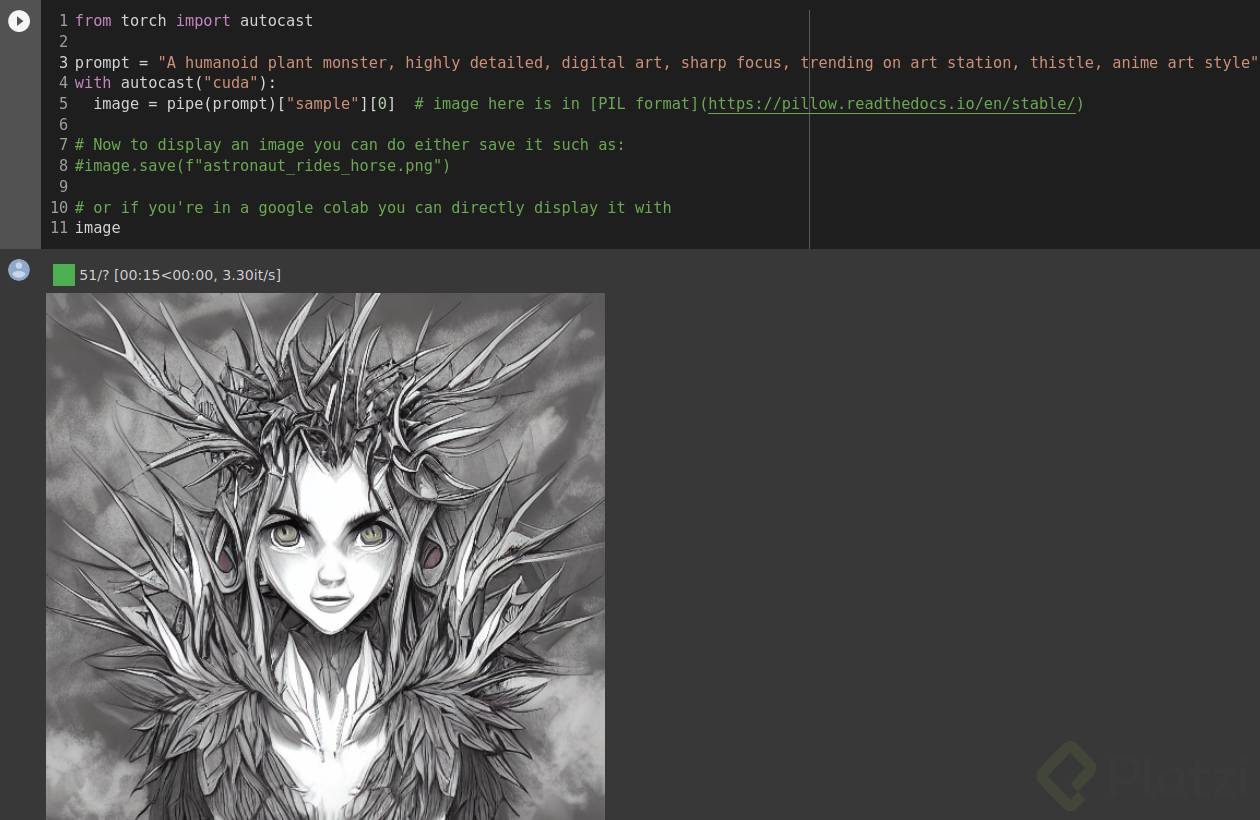

Puedes utilizar el código libre de https://huggingface.co, la mayor comunidad libre de datasets, modelos y documentación de AI.

Para ello, podemos utilizar directamente este cuaderno de colab. Sigue los siguientes pasos:

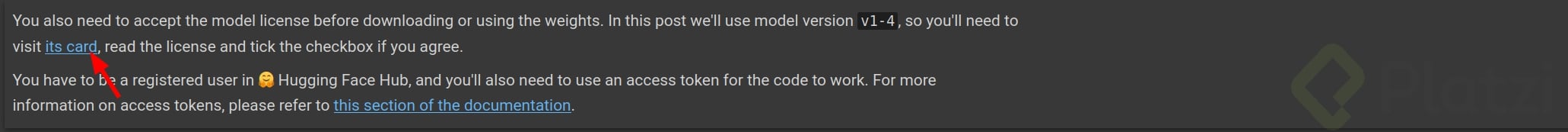

- Crea una cuenta en huggingface 🤗

- Aceptar términos y condiciones de este enlace (el notebook de colab igualmente lo pedirá en un punto pero si ya se realizo no hay necesidad de hacerlo nuevamente 🙂)

- Garantizar que estamos usando GPU como entorno de ejecución en el cuaderno de google colab.

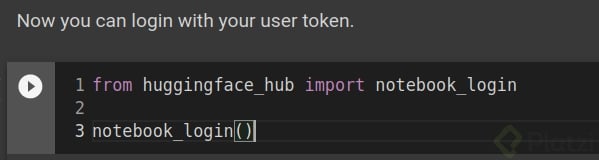

- Ejecutar las celdas una a una, hasta el login con huggingface:

- Indicar el token de huggingface, el cual puedes conseguir registrándote en la página de hoggingface y en los settings crear uno.

- Ejecutar las celdas una a una hasta este punto, donde deberás escribir en la variable

promptlo que quieres generar.

- ¡Diviértete generando todo tipo de imágenes!

📌 Complementa siempre con una parte humana 🎨. Refina tus habilidades en dibujo tradicional con el Curso de Dibujo Anatómico.

Cuál es el impacto de un modelo libre de esta magnitud

Un dato para resaltar es el hecho de que este modelo fue entrenado por un grupo de personas que querían un proyecto totalmente libre. Su idea era competir contra Dalle2, Imagen, Midjourney y otros, así que se organizaron y crearon algo maravilloso, con datasets igualmente abiertos a todo público.

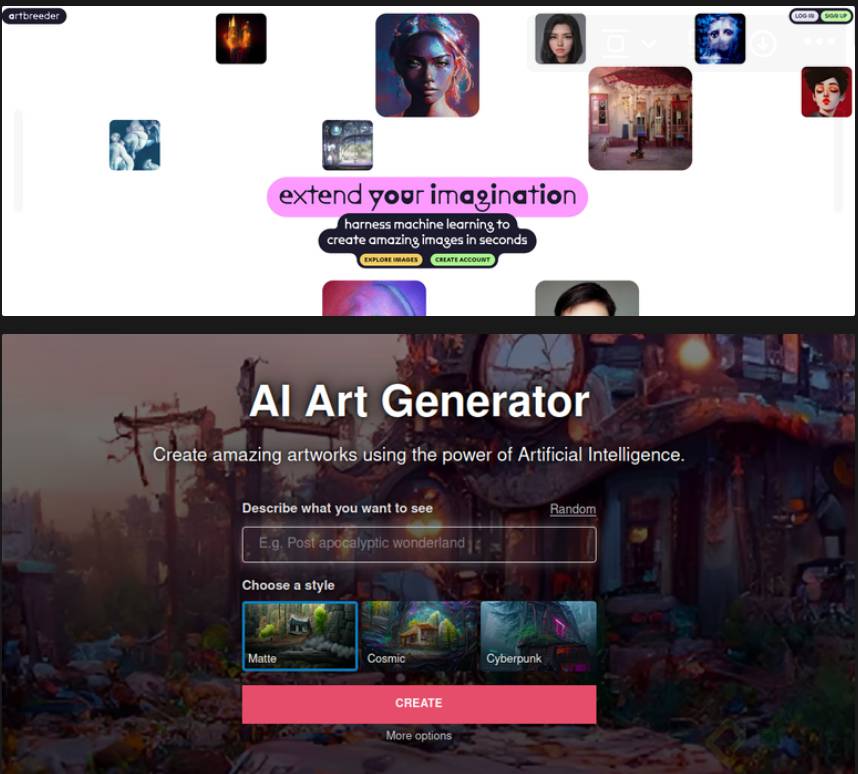

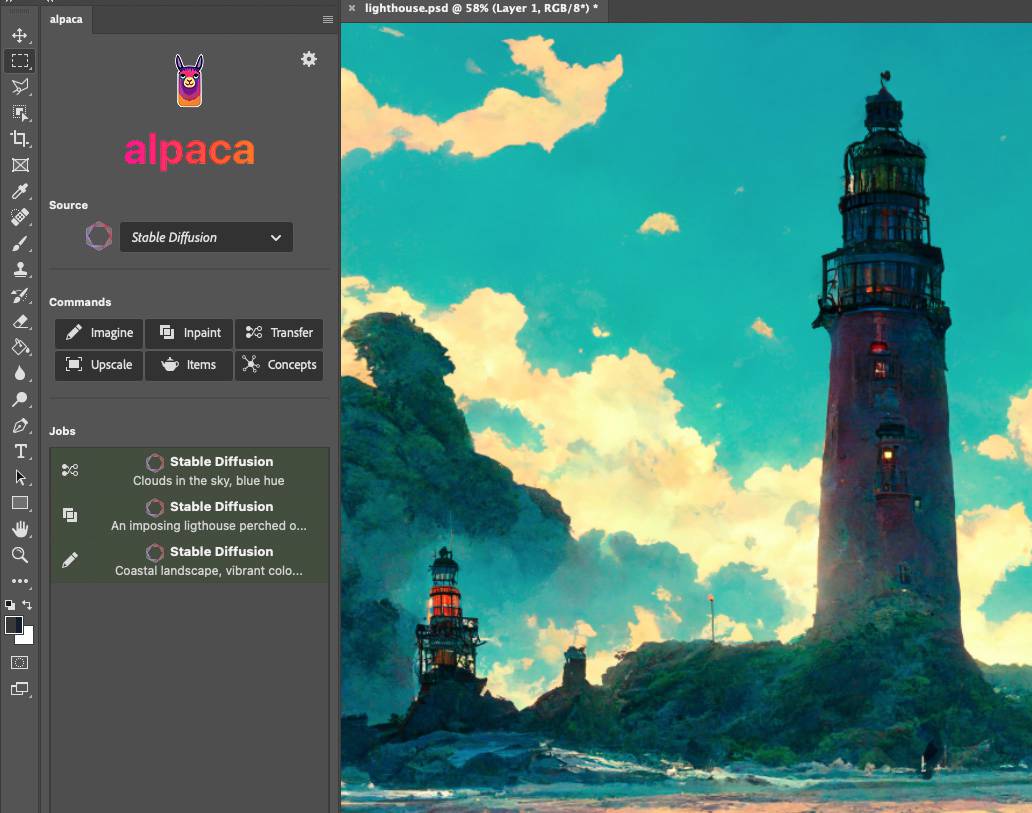

Al ser un modelo libre es de esperar que tengamos ahora múltiples páginas, aplicaciones, startups y demás entidades usando estos modelos para crear productos a otro nivel. Eso beneficia a la industria y la innovación.

Algunos ejemplos son artbredeer, nightcafe, gealpaca.io algunos plugins en figma, etc.

Además, se está hablando de trabajo en conjunto con MidJourney y también publicar un API para integraciones con múltiples módulos.

Te dejo algunos enlaces que te serán de utilidad si te interesa conocer más del tema:

- Página oficial de Stable Diffusion

- Modelo en Hugging Face

- Notebook de guía

- Lexica una guía para mejorar los promts a ejecutar

- Dreamstudio

- Un blog escribí previamente sobre DALL-E e Imagen.

Pero para llevarlo a su máximo nivel, con un paso a paso detallado, te invito a tomar el Curso de Stable Diffusion para Generación de Imágenes con IA del que tengo el gusto de acompañarte como profesor. 🚀

¡Sígueme en Instagram/Twitter/TikTok como @alarcon7a, hasta una próxima!

Curso de Generación de Imágenes con IA: Dall-E, Midjourney y Stable Diffusion

COMPARTE ESTE ARTÍCULO Y MUESTRA LO QUE APRENDISTE